GTC 2022 - NVIDIA's self-driving cars

원본 영상

https://youtu.be/LjoxHaDCusY

Summary

- Ground truth 데이터를 얻는 방법

- DeepMap 회사 인수

- HD Mapping (DRIVE MAP) 알고리즘

- Omniverse 시뮬레이터

- Human-labeled 데이터

- 딥러닝 네트워크 트레이닝

- DGX 학습 워크스테이션

- DRIVE AV 알고리즘

- 디지털 트윈 워크스테이션

- OVX 학습 워크스테이션

- 자동차에 올라가는 보드

- NVIDIA Jetson AGX Orin

NVIDIA Drive 데모

지도 생성 (NVIDIA DRIVE Map)

TLDR; 자동 맵핑

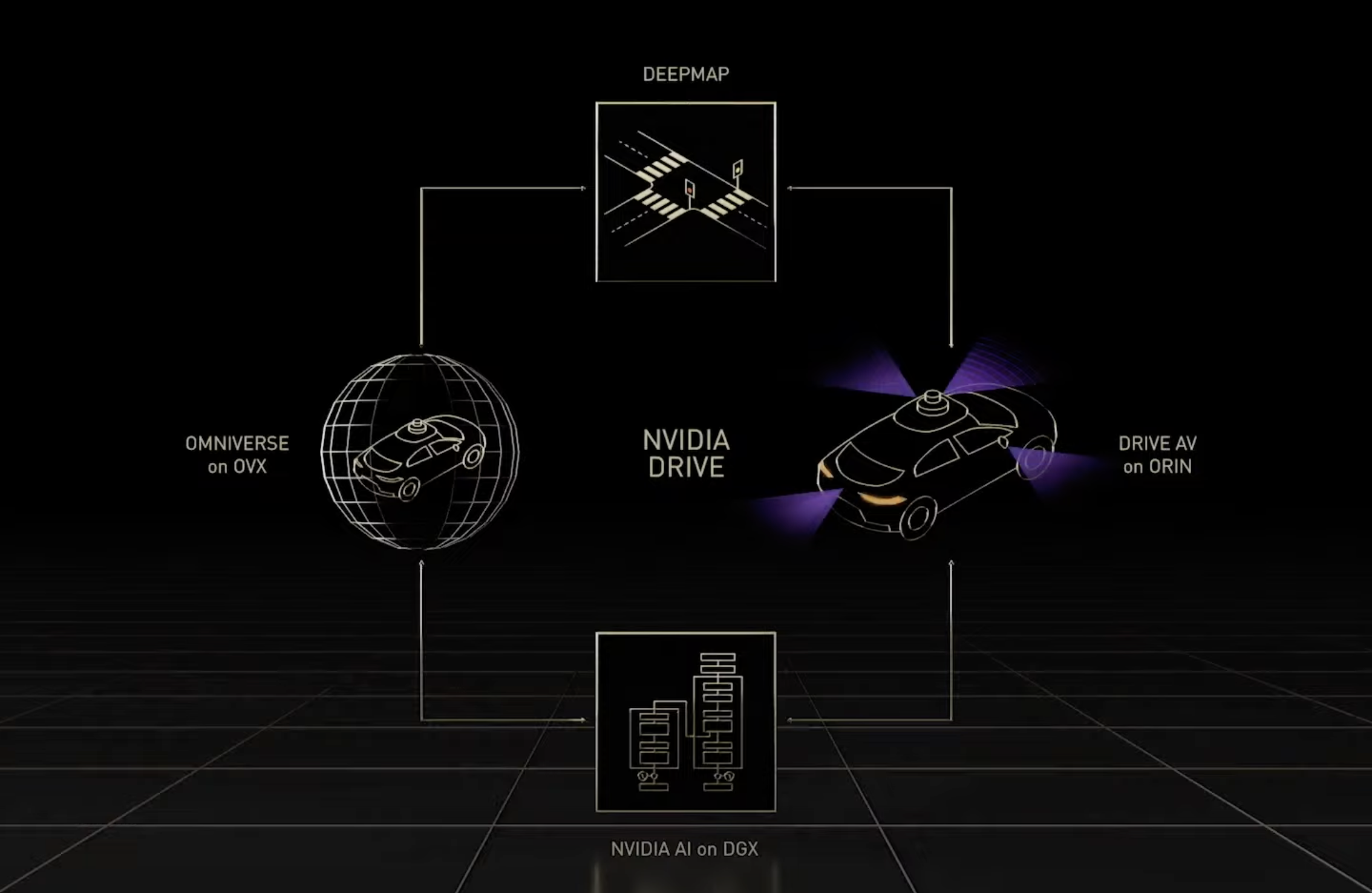

HD Mapping (DRIVE MAP) 알고리즘을 기반으로 사전에 이미 따놓은 지도를 사용함. 이 지도는 NVIDIA가 인수한 DeepMap이라는 회사의 알고리즘과 기존의 NVIDIA가 만든 DRIVE Map 기술의 클라우드 인프라를 합친 것임.

DRIVE Concierge

TLDR; 잘되는 대화형 AI. 시선인식. 멀티모달 디텍션. 자동주차. 서라운드뷰 모니터링.

데모에서 주인공은 차를 탄다. 차를 타면 대화형 AI인 DRIVE 아바타가 반겨준다.

주인공의 친구가 ‘San Jose civic에서 나 좀 태워줘’라는 문자를 받은걸 아바타가 주인공에게 알려주며, ‘거기로 갈까요?’라고 물어본다. 주인공은 ‘응 거기로 가자’라고 얘기하고, 아바타는 목적지를 그곳으로 설정한다.

운행을 시작하고 얼마 안되서 ‘DRIVE Pilot 실행해’라고 말함으로써 자율주행이 시작된다.

주인공이 ‘친구에게 가고있다고 알려줄래?’ 라고 얘기하니, 아바타는 주인공의 친구에게 ‘12분 후 도착 예정’이라는 문자를 보낸다.

보행자, 공사 사인 등을 잘 피해간다. 움직이는 객체들에 대해서는 confidence map을 통해 검출 정확도도 표시한다. 자전거 도로도 잘 피해낸다.

차는 특정 인물을 검출할 수 있는 능력이 있어, 주인공의 친구를 바로 알아챈다.

주인공이 바깥을 바라보며 ‘저 빌딩이 뭐야?’라고 물어본다. 이 때, 자동차는 시선트랙킹을 통해 어떤 빌딩을 이야기하는지 추론한다. 주인공이 물어본 빌딩은 쇼를 하는 곳인데, 주인공은 ‘무슨 쇼를 하는지’ 물어보고 아바타가 답을해주자 ‘토요일 저녁에 티켓 2개 예약해줘’라고 한다.

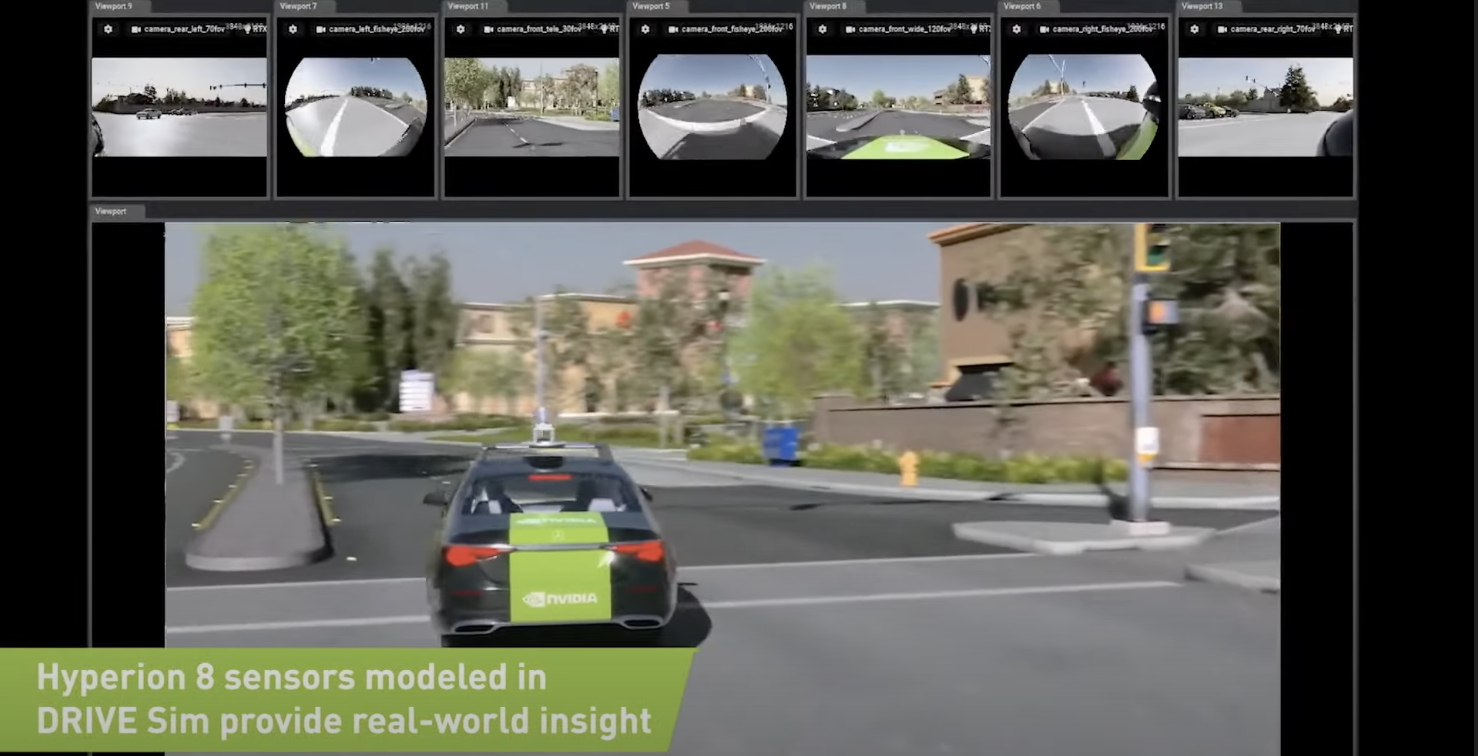

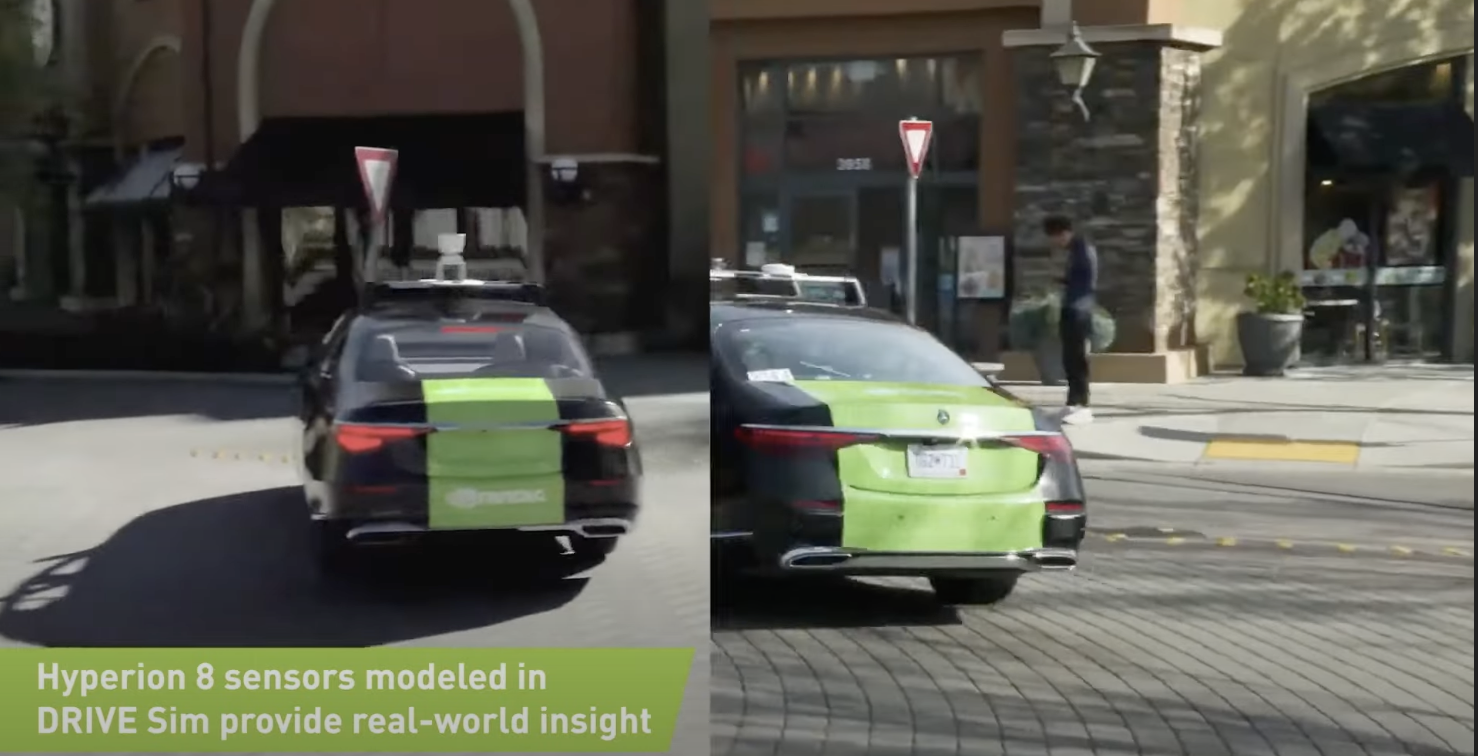

데모에서는 실제 세상과 Omniverse 기반의 DRIVE SIM의 세상이 거의 비슷하다고 이야기한다. DRIVE SIM에서도 NVIDIA 자동차 플랫폼인 Hyperion 8과 동일한 센서를 가지고 있다.

좌측 이미지가 omniverse 시뮬레이션, 오른쪽이 실제이다.

도착하고나서, 주인공은 ‘차를 주차해줘’라고 얘기한다. 자동차는 Surround view를 이용해서 주변에 주차할 수 있는 곳을 자동으로 탐색해 주차에 성공한다.

Hyperion 8 플랫폼

TLDR; 잘나가는 히페리온 8

Hyperion 8 플랫폼은 NVIDIA DRIVE의 가장 중요한 부분이다. 센서, 네트워크, 2개의 드라이빙을 위한 컴퓨터, 1개의 아바타 컴퓨터, 1개의 mission recorder, safety + cybersecurity 시스템이 있다고 한다.

8개의 카메라를 사용해서 360 각도를 커버한다. 레이더, 라이다, 초음파 센서를 사용하고 있다.

2024년부터 벤츠 차에 올라간다. 2025년에는 재규어 랜드로버에 올라간다.

Hyperion 9 플랫폼

TLDR; 더 잘나갈 히페리온 9

2026년부터 차에 탑재될 새로운 Hyperion 9 플랫폼도 공개했다.

14 카메라, 9개 레이더, 3개 라이다, 20 초음파 센서를 사용한다. Hyperion 8보다 2배나 되는 센서의 양을 처리할 수 있다.

DRIVE map

TLDR; 지구 스케일 지도 딸 예정. DRIVE map으로 딴 다음에 omniverse에 올려서 다양한 상황 시뮬레이션 가능. 또, 최근 연구하는 기술로는 NeRF를 써서 새로운 시점에서의 데이터 생성 및 물리적인 렌더링 가능.

카메라, 레이더, 라이다로 지도를 만든다. 각각의 센서가 모든 지도 레이어에 접근해서 독립적으로 위치 추정을 수행할 수 있다.

DRIVE map은 2가지 모드가 있다. 1. Ground truth survey mapping, 2. Crowd-sourced fleet mapping 이다. 아마 전자는 엄청나게 센서가 많은 차량이 돌아다니면서 정확하게 맵을 잡아내는걸꺼고, 후자는 양산된 차들이 돌아다니면서 맵을 업데이트 시켜주는 걸 것이다.

2024년까지 북미, 유럽, 아시아의 대부분의 고속도로 지도를 따서 디지털 트윈을 만들 계획을 추진하고 있다고 한다. 목표는 지구의 스케일의 디지털 트윈을 만들어서, 자율주행 차를 출시하기 전에 엄청난 양의 데이터로 안전을 검증하는 시스템을 만드는 것이라고 한다.

현재 이를 위해 2가지 방법을 쓰고 있다고 한다.

첫번째 방법은 NVIDIA DRIVE Map을 NVIDIA Omniverse로 로딩한 후, 실제 객체들의 위치에 가상 렌더링 객체를 올려 정확한 그래픽 요소를 채운다.

그 후, DRIVE Map에 있는 동적 객체들을 딥러닝으로 검출해서, 그 위치를 디지털 트윈으로 대체한다. 해당 객체들은 이제 직접 컨트롤 할 수 있게 되며, 이를 통해 다양한 상황들을 시뮬레이션으로 만들어낼 수 있다.

두번째 방법은, 운전 중에 녹화된 영상을 기반으로 3D reconstruction을 사용해서 지도를 만든다. 동적 객체들을 검출해서 정적 물체만 가득한 지도를 만들고, 빈 곳들은 neural reconstruction (i.e. NeRF)를 이용해서 채워넣는다. 또, NeRF를 사용해서 자동차의 시점을 원하는대로 돌려 새로운 데이터를 만들어낼 수 있다.